Sztuczna inteligencja Google DreamBooth jest już dostępna. Nowo wydane technologie, takie jak DALL-E 2 OpenAI lub Stable Diffusion i Midjourney firmy StabilityAI, już podbijają Internet. Teraz nadszedł czas na dostosowanie wyników. Ale jak? Odpowiedzi udzieliły Boston University i Google, a my szczegółowo je dla Ciebie.

DreamBooth potrafi rozpoznać temat obrazu, zdekonstruować go z oryginalnego kontekstu, a następnie precyzyjnie zsyntetyzować w nowy, pożądany kontekst. Dodatkowo może być używany z aktualnymi generatorami obrazu AI. Dowiedz się więcej o wyobraźni opartej na sztucznej inteligencji, czytając dalej.

Wyjaśnienie Google DreamBooth AI

Firma Google zaprezentowała DreamBooth, nowy model dyfuzji tekstu na obraz. Google DreamBooth AI może tworzyć szeroką gamę obrazów na wybrany przez użytkownika temat w różnych warunkach, korzystając z podpowiedzi tekstowej jako instrukcji.

DreamBooth, rewolucyjna metoda modyfikowania mocno przeszkolonych modeli tekstu na obraz, została stworzona przez zespół badawczy z Boston University i Google. Ogólnie rzecz biorąc, pomysł jest dość prosty: chcą rozszerzyć słownik wizji języka tak, aby rzadkie identyfikatory tokenów były powiązane z konkretnym tematem, który chce stworzyć użytkownik.

Najważniejsze cechy Google DreamBooth AI:

- Dzięki 3-5 zdjęciom DreamBooth AI może ulepszyć model tekstu na obraz.

- Używając DreamBooth AI, można tworzyć całkowicie oryginalne fotorealistyczne obrazy obiektu.

- Dodatkowo DreamBooth AI jest w stanie tworzyć obrazy przedmiotu z różnych perspektyw.

Głównym celem modelu jest dostarczenie użytkownikom narzędzi niezbędnych do tworzenia fotorealistycznych reprezentacji wystąpień wybranej przez nich tematyki i połączenie ich z modelem dyfuzji tekstu na obraz. W rezultacie metoda ta wydaje się być skuteczna w podsumowywaniu problemów w różnych okolicznościach.

DreamBooth firmy Google ma nieco inne podejście niż inne niedawno wydane narzędzia do przetwarzania tekstu na obraz, takie jak DALL-E 2, Stabilna dyfuzjaoraz W połowie drogi pozwalając użytkownikom na większą kontrolę nad obrazem tematu, a następnie kontrolując model dyfuzji za pomocą danych wejściowych tekstowych.

DreamBooth może również pokazać temat z różnych kątów kamery za pomocą zaledwie kilku zdjęć wejściowych. Sztuczna inteligencja (AI) może przewidywać cechy obiektu i syntetyzować je w nawigacji tekstowej, nawet jeśli zdjęcia wejściowe nie dostarczają danych na dany temat z różnych punktów widzenia.

Model ten może też syntetyzować fotografie, tworząc inne nastroje, dodatki, czy zmiany kolorystyczne za pomocą wskazówek językowych. Dzięki tym funkcjom DreamBooth Google AI oferuje użytkownikom jeszcze większą personalizację i swobodę twórczą.

Artykuł DreamBooth „DreamBooth: Precyzyjne dostrajanie modeli dyfuzji tekstu na obraz w celu generowania na podstawie tematu” twierdzi, że dostarczają jednej nowatorskiej kwestii i podejścia:

- Generowanie tematyczne to nowy problem.

Biorąc pod uwagę kilka pospiesznie zrobionych obrazów obiektu, celem jest stworzenie nowych reprezentacji obiektu w różnych ustawieniach, przy jednoczesnym zachowaniu wysokiej wierności jego podstawowym cechom wizualnym.

Aplikacje Google DreamBooth AI

Najlepsze aplikacje Google DreamBooth AI to:

- Rekontekstualizacja

- Interpretacje dzieł sztuki

- Manipulacja wyrażeniami

- Nowe spojrzenie na syntezę

- Akcesoria

- Modyfikacja właściwości

Czy jesteś gotów rozstać się z PhotoShopem? Przyjrzyjmy się im bliżej, korzystając z pouczających obrazów stworzonych przez Nataniel Ruiz i ekipa DreamBooth.

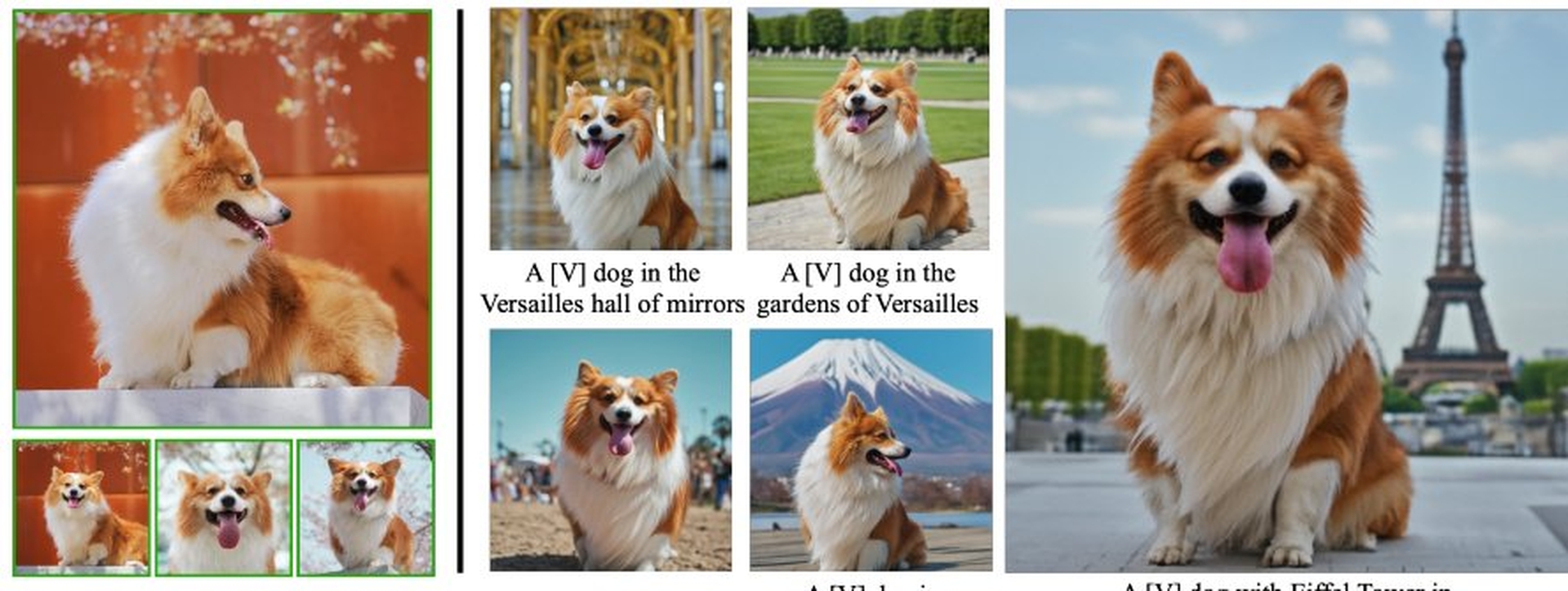

Rekontekstualizacja

Podając frazę zawierającą unikalny identyfikator i rzeczownik klasy do wyszkolonego modelu, DreamBooth AI może tworzyć unikalne obrazy dla określonej instancji podmiotu. Zamiast modyfikować tło, DreamBooth AI może stworzyć obiekt w innowacyjnych, wcześniej niewidzianych pozycjach, artykulacjach i strukturze sceny. realistyczne cienie i odbicia, a także interakcja obiektu z sąsiednimi obiektami. To pokazuje, że ich strategia oferuje coś więcej niż tylko ekstrapolację lub wyszukiwanie istotnych informacji.

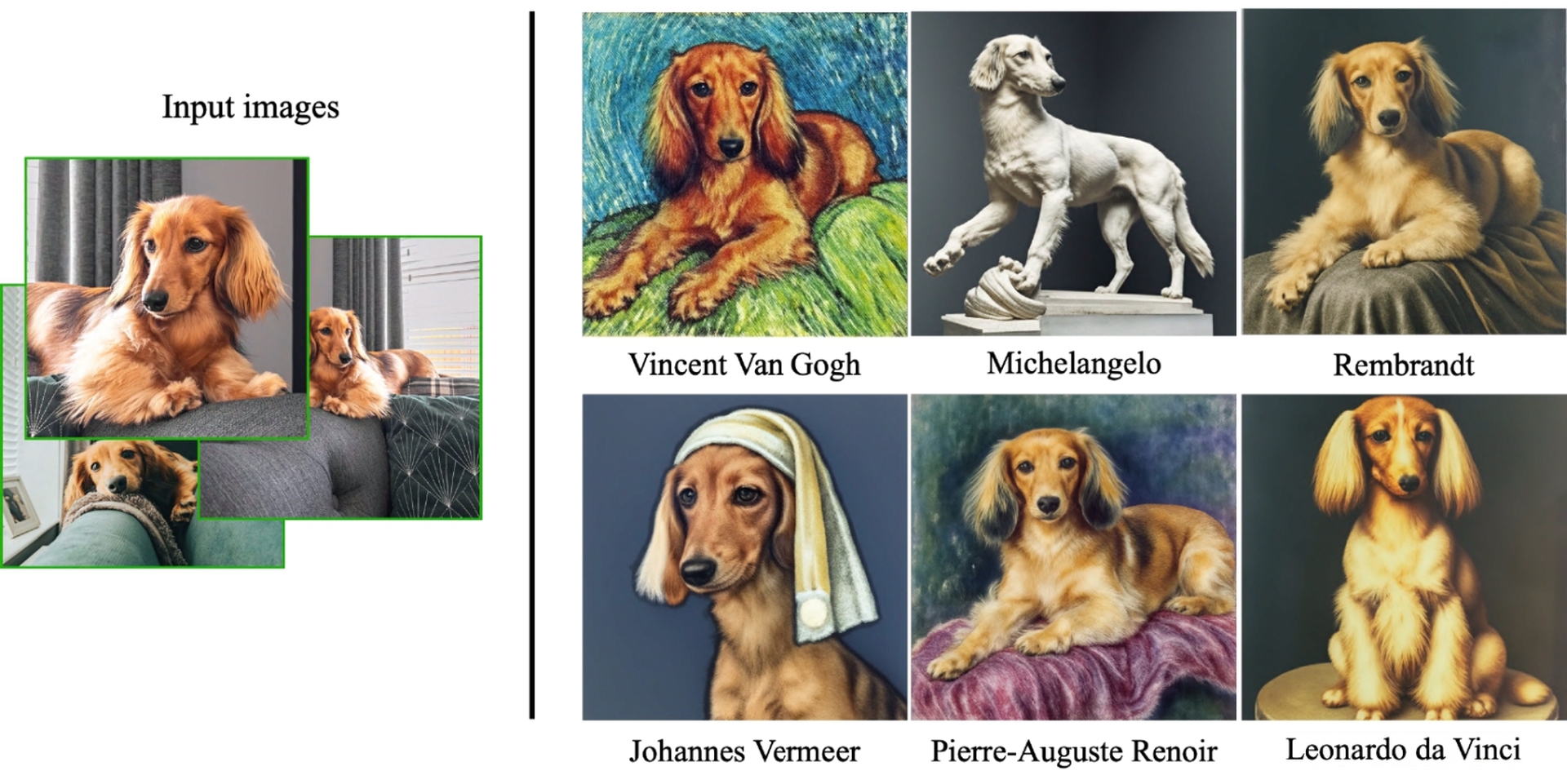

Interpretacje dzieł sztuki

Jeśli masz możliwość wyboru między „pomnikiem a [V] [class noun] w stylu [great sculptor]” i „obraz [V] [class noun] w stylu [famous painter],” Które byś wybrał? Za pomocą DreamBooth AI można tworzyć oryginalne, kreatywne reprezentacje.

W szczególności to zadanie różni się od transferu stylu, który zachowuje semantykę sceny źródłowej, jednocześnie stosując styl innego obrazu do oryginalnej sceny. W przeciwieństwie do tego, w zależności od stylu twórczego, sztuczna inteligencja może osiągnąć duże zmiany sceny ze szczegółami instancji podmiotu i zachowaniem tożsamości.

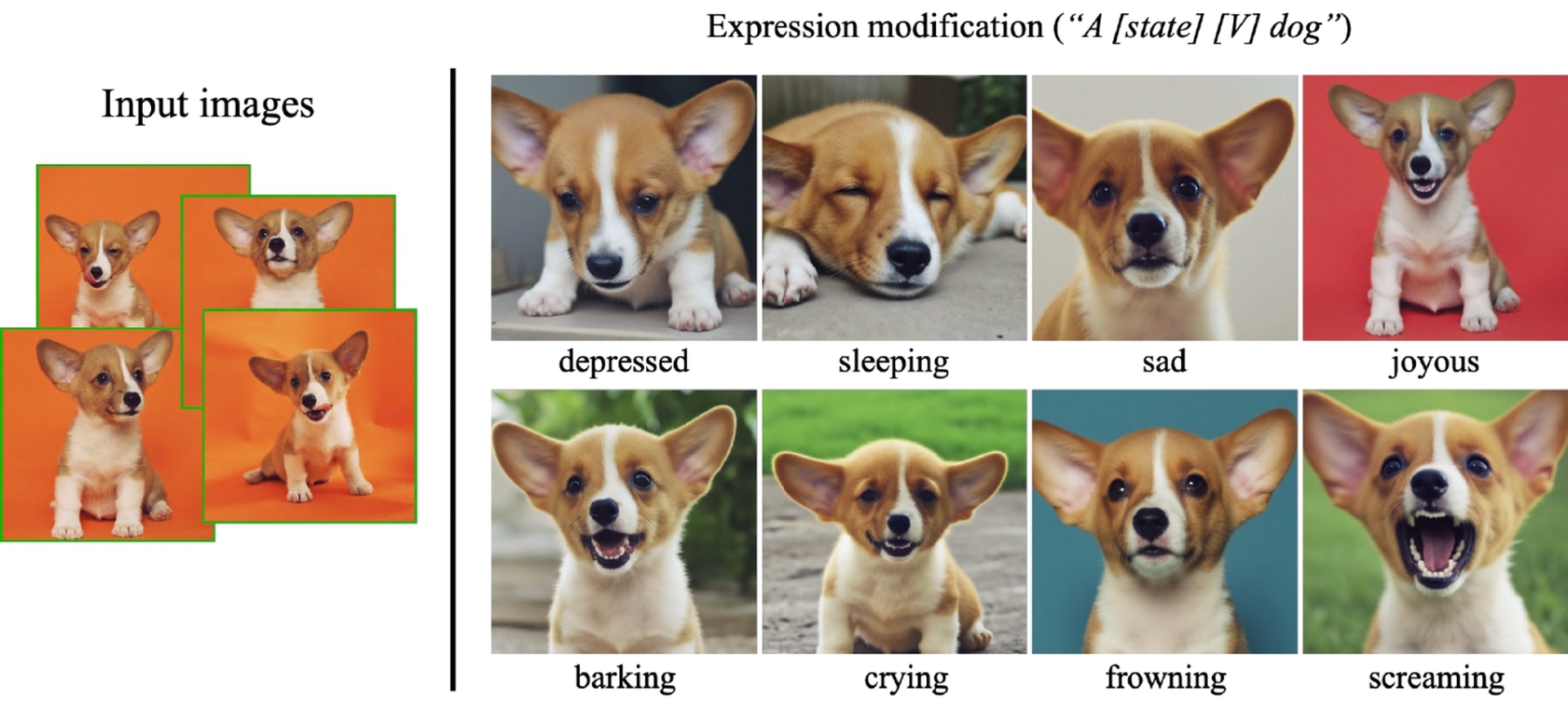

Manipulacja wyrażeniami

Z pomocą metody Google DreamBooth AI, nowe zdjęcia obiektu mogą być tworzone z różnymi wyrazami twarzy niż te z oryginalnego zestawu zdjęć.

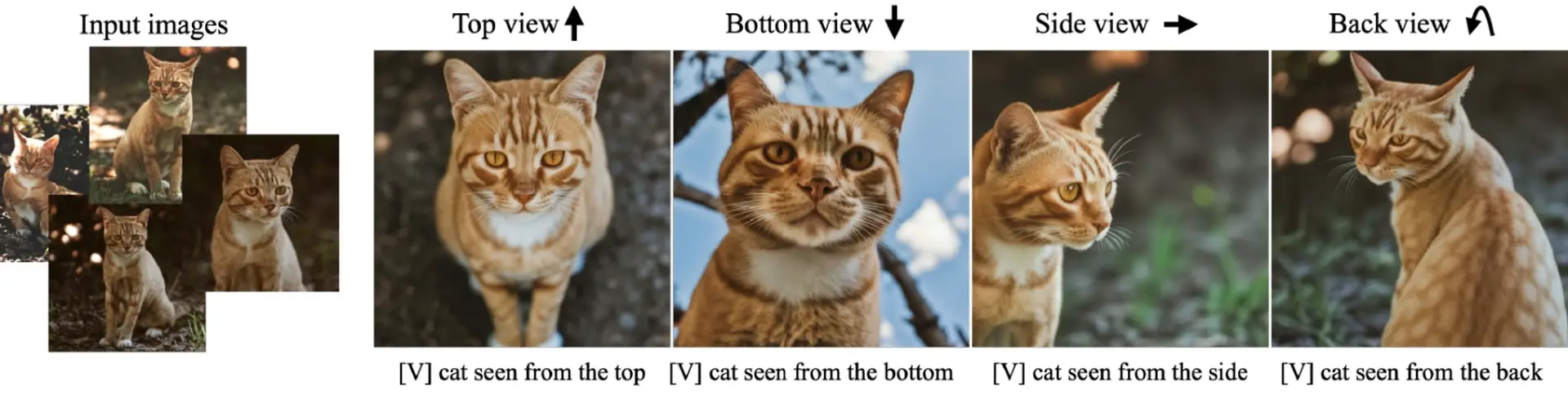

Nowe spojrzenie na syntezę

Google DreamBooth AI może przedstawiać temat z wielu unikalnych perspektyw. Na przykład DreamBooth AI może tworzyć świeże obrazy tego samego kota przy użyciu różnych kątów kamery, przepełnione niezawodnie szczegółowymi wzorami futra.

Pomimo tego, że model ma tylko cztery przednie zdjęcia kota, DreamBooth AI jest w stanie wywnioskować informacje z klasy przed stworzeniem tych kreatywnych punktów widzenia, mimo że nigdy nie widział tego samego kota z boku, z dołu lub z góry.

Akcesoria

Intrygujący aspekt zdolności DreamBooth AI do upiększania obiektów pochodzi z silnego uprzedniego kompozycyjnego modelu generacji. Dla ilustracji, model jest proszony o zdanie w postaci „a [V] [class noun] ma na sobie [accessory]”. Dzięki temu możemy w atrakcyjny sposób przyczepiać na psie różne przedmioty.

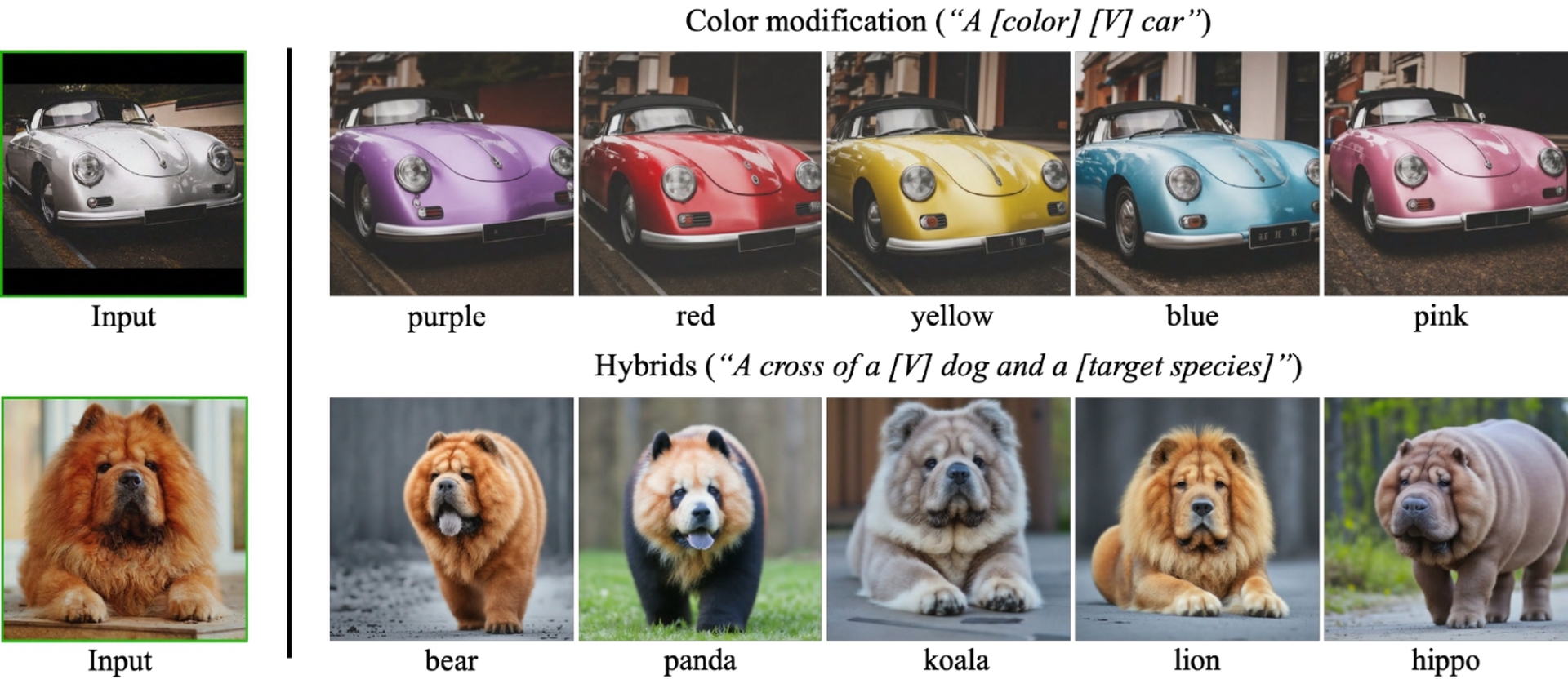

Modyfikacja właściwości

DreamBooth AI jest w stanie zmienić właściwości instancji podmiotu. Przymiotnik koloru może być użyty w przykładowym zdaniu „a [color adjective] [V] [class noun]”. Może to zaowocować świeżymi, żywymi przykładami tego tematu. Istnieje kilka wymagań, ale te cechy wyjaśniają również, jak korzystać ze sztucznej inteligencji DreamBooth.

Korzystasz ze sztucznej inteligencji Google DreamBooth?

Technika DreamBooth AI pobiera jako dane wejściowe niewielką liczbę zdjęć (zwykle wystarczy 3-5 obrazów) obiektu (na przykład konkretnego psa) i powiązanej z nim nazwy klasy (na przykład „pies”). Następnie tworzy model tekstu na obraz, który został zmodyfikowany i „spersonalizowany” i koduje unikalną tożsamość tematu. Aby zsyntetyzować tematy w różnych kontekstach, DreamBooth AI może następnie wstawić charakterystyczną identyfikację do różnych fraz. Mając od trzech do pięciu obrazów obiektu, możesz dostosować rozproszenie tekstu do obrazu w dwóch krokach:

- Monit tekstowy z określonym kodem i nazwą klasy, do której należy przedmiot (na przykład „obraz [T] canine”) zostanie wykorzystany do ulepszenia modelu zamiany tekstu na obraz o niskiej rozdzielczości. Ponadto używają one wcześniejszej utraty zachowania specyficznej dla klasy, która wykorzystuje semantyczny uprzedni model w klasie i zachęca ją do generowania szeregu przykładów, które są członkami klasy podmiotu, umieszczając nazwę klasy w polu tekstowym (na przykład , „zdjęcie psa”).

- Wielką wierność osiągamy, dostrajając komponenty super rozdzielczości za pomocą par zdjęć o niskiej i wysokiej rozdzielczości z naszego zestawu obrazów wejściowych.

Pierwszy Dreambooth powstał przy użyciu Obrazekparadygmat tekstu na obraz. Model i ciężary z Imagen nie są jednak dostępne. Jednak korzystając z kilku przykładów, Dreambooth on Stable Diffusion umożliwia użytkownikom dostosowanie modelu tekstu do obrazu.

Jak korzystać z Google Dreambooth AI na stabilnej dyfuzji?

Aby korzystać z DreamBooth AI na stabilnej dyfuzji, postępuj zgodnie z następującymi krokami:

- Postępuj zgodnie z instrukcjami konfiguracji w repozytorium Textual Inversion lub oryginalnym repozytorium Stable Diffusion, aby skonfigurować środowisko LDM.

- Aby dostroić stabilny model dyfuzji, musisz otrzymać przeszkolone modele stabilnej dyfuzji i postępować zgodnie z ich instrukcjami. Wagi można pobrać z PrzytulanieTwarz.

- Przygotuj serię obrazów do uregulowania zgodnie z wymaganiami metody dostrajania Dreambooth.

- Możesz ćwiczyć za pomocą następującego polecenia:

1 2 3 4 5 6 7 8 | python main.py --base configs/stable-diffusion/v1-finetune_unfrozen.yaml -t --actual_resume /path/to/original/stable-diffusion/sd-v1-4-full-ema.ckpt -n <job name> --gpus 0, --data_root /root/to/training/images --reg_data_root /root/to/regularization/images --class_word <xxx> |

Pokolenie

Po przeszkoleniu polecenie może służyć do uzyskania spersonalizowanych przykładów.

1 2 3 4 5 6 7 | python scripts/stable_txt2img.py --ddim_eta 0.0 --n_samples 8 --n_iter 1 --scale 10.0 --ddim_steps 100 --ckpt /path/to/saved/checkpoint/from/training --prompt "photo of a sks <class>" |

W szczególności class> jest słowem klasowym — słowem klasowym oznaczającym szkolenie — a sks jest identyfikatorem (który, jeśli chcesz go zmienić, powinien zostać zastąpiony własnym wyborem). Aby uzyskać więcej informacji, odwiedź Strona GitHub dla DreamBooth Stable Diffusion.

Ograniczenia Dreambooth AI

Ograniczenia DreamBooth AI są następujące:

- Dryf językowy

- Dopasowanie

- Utrata zachowania

Przyjrzyjmy się im bliżej.

Dryf językowy

Tworzenie iteracji w temacie o wysokim stopniu szczegółowości jest utrudnione przez wiersz polecenia. DreamBooth może zmienić kontekst tematu, jednak istnieją problemy z ramką, jeśli model chce zmienić rzeczywisty temat.

Dopasowanie

Innym problemem jest nadmierne dopasowanie obrazu wyjściowego do oryginalnego obrazu. Temat może nie zostać oceniony lub może być połączony z kontekstem przesłanych obrazów, jeśli nie ma wystarczającej liczby zdjęć wejściowych. Dzieje się tak również, gdy pytany jest kontekst dla nieparzystego pokolenia.

Utrata zachowania

Kolejnymi ograniczeniami są niezdolność do syntezy obrazów o rzadszych lub bardziej złożonych tematach, a także wierność tematu zmiennego, która może skutkować halucynogennymi przesunięciami i nieciągłością. Kontekst wejściowy jest często zawarty w temacie obrazów wejściowych.

Społeczne oddziaływanie sztucznej inteligencji

Celem projektu DreamBooth jest dostarczenie użytkownikom praktycznego narzędzia do syntezy osobistych tematów (zwierząt, obiektów) w różnych ustawieniach. Podczas gdy standardowe algorytmy zamiany tekstu na obraz mogą być nastawione na określone aspekty podczas syntezy obrazów ze słów, pomaga to użytkownikowi lepiej odtworzyć wybrane tematy. Jednak złośliwe strony mogą próbować oszukać użytkowników, wykorzystując podobne obrazy. Różne metody modeli generatywnych lub techniki modyfikacji treści wykazują ten powszechny problem.

Wniosek

Większość modeli tekstu na obraz wymaga milionów parametrów i bibliotek do tworzenia danych wyjściowych z pojedynczego tekstu wejściowego. DreamBooth ułatwia użytkownikom uzyskiwanie treści i korzystanie z nich, po prostu wymagając wprowadzenia od trzech do pięciu obrazów tematu wraz z napisanym tłem.

Charakterystyczne cechy tematu mogą zatem zostać zachowane, podczas gdy wyszkolony model ponownie wykorzystuje materialistyczne aspekty podmiotu wyuczonego z obrazów, aby odtworzyć je w innych ustawieniach i punktach widzenia. Większość algorytmów konwersji tekstu na obraz opiera się na określonych słowach kluczowych i może priorytetyzować określone atrybuty podczas wyświetlania obrazów. Użytkownicy DreamBooth mogą uzyskać fotorealistyczne wyniki, widząc wybraną osobę w unikalnym środowisku lub scenariuszu. Więc przestań teraz czekać. Spróbuj teraz!

Mamy nadzieję, że spodobał Ci się ten artykuł na temat korzystania ze sztucznej inteligencji Google Dreambooth w stabilnej dyfuzji. Jeśli tak, jesteśmy pewni, że spodoba ci się również czytanie niektórych naszych innych artykułów, takich jak DALL-E 2 wprowadził przemalowywanie: AI wyobraża sobie poza granicami lub Generator grafiki Stable Diffusion AI: Podpowiedzi, przykłady i sposób uruchamiania.

Source: Jak korzystać z Google Dreambooth AI na stabilnej dyfuzji?