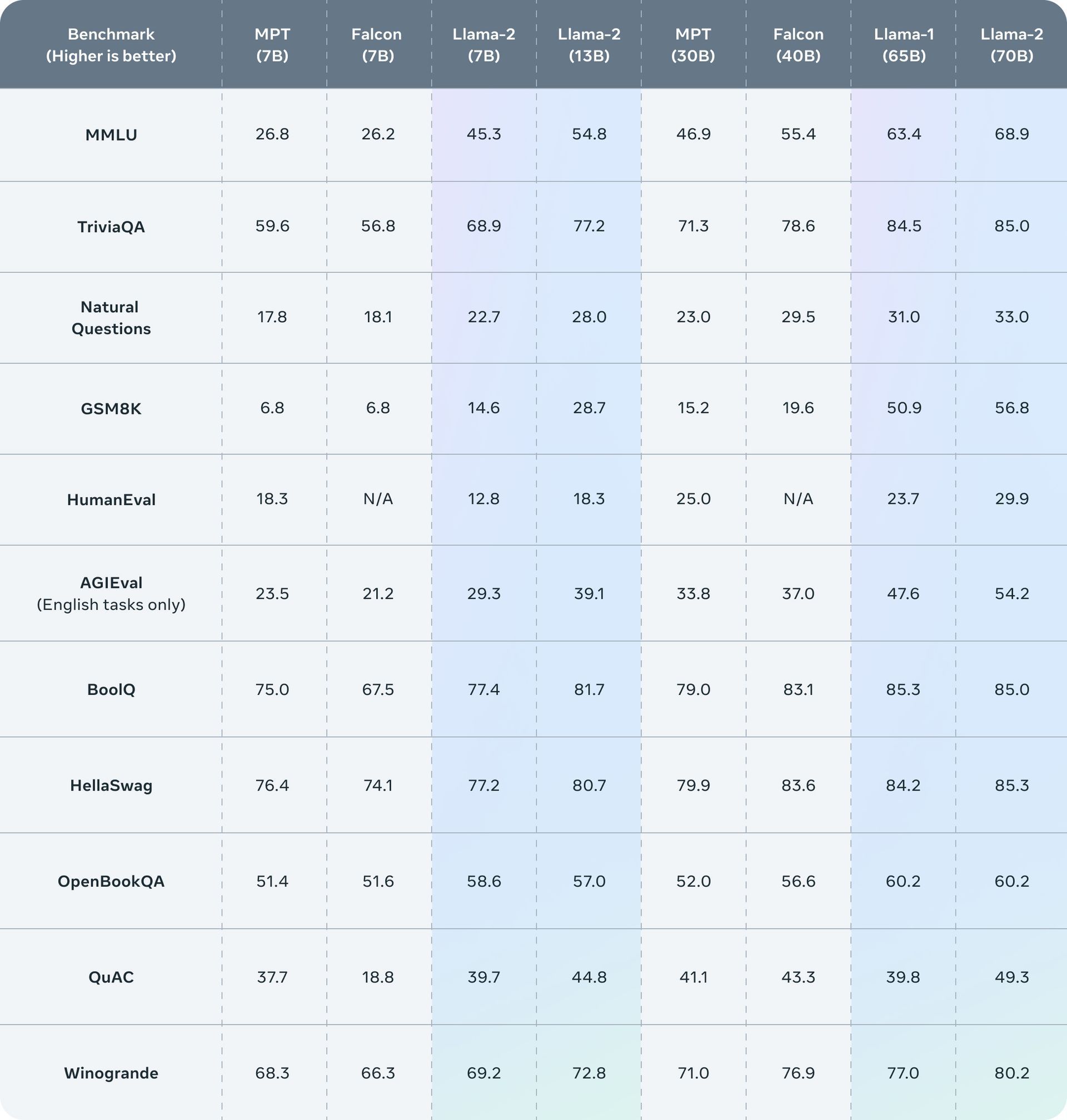

Meta AI: W tym poście wyjaśnimy, czym jest lama 2 i jak z niej korzystać. Meta zaprezentowała swój najnowszy duży model językowy (LLM) Llama 2, który w testach przewyższył inne modele czatów typu open source (w tym GPT) w większości testów porównawczych, w tym pod względem przydatności i bezpieczeństwa.

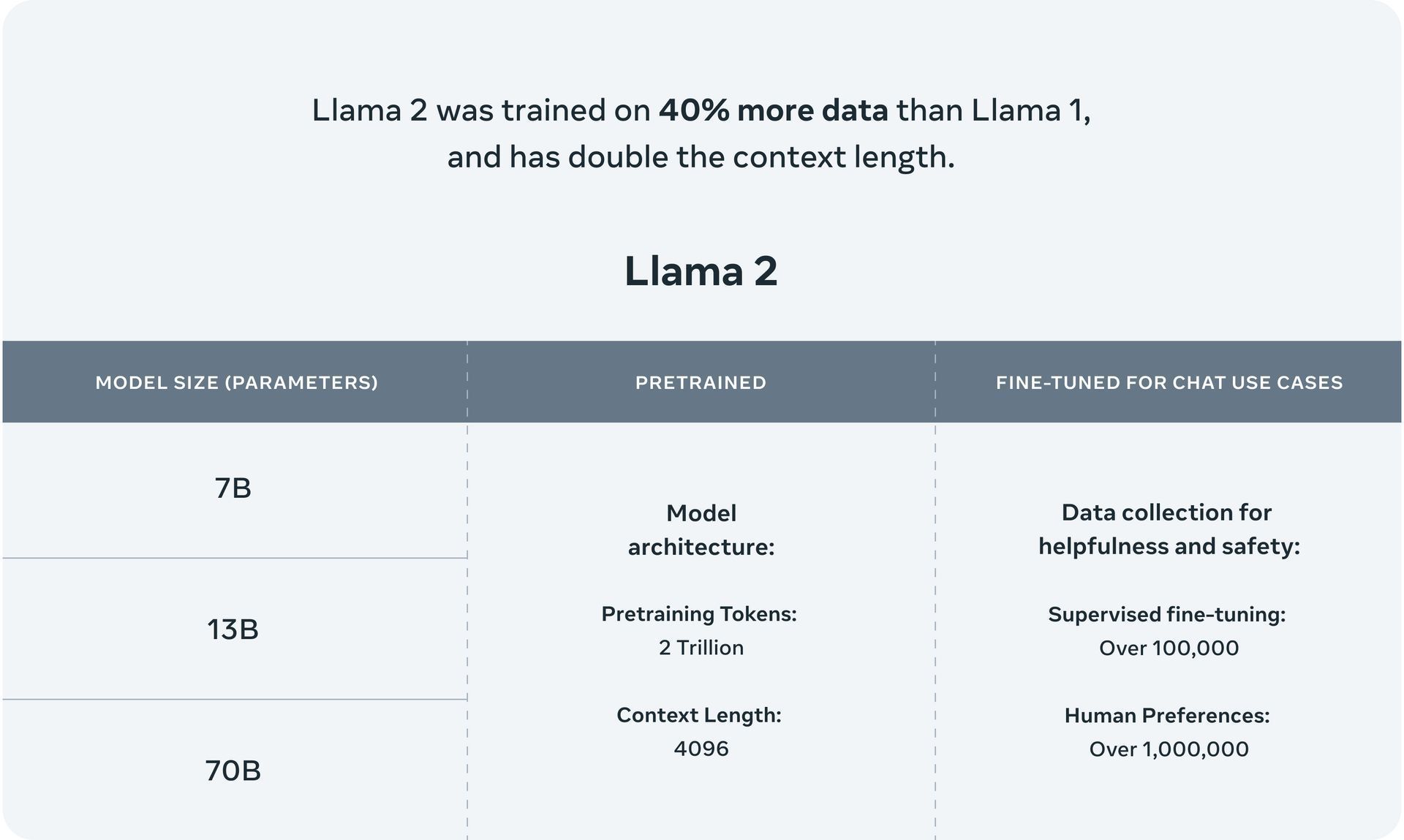

Oprócz opublikowania trzech alternatywnych modeli w ramach nowej wersji — jednego wytrenowanego na 7 miliardach parametrów, jednego na 13 miliardach i ostatecznie wersji 70 miliardów — Meta AI udostępnia również „Llama 2 Chat”, bardziej wyrafinowany wariant przeznaczony wyłącznie do konwersacyjnych przypadków użycia.

Jest to osiągnięcie technologiczne samo w sobie, ale bardziej intrygujące jest to, że Meta i Microsoft ogłosiły również zacieśnienie współpracy, umożliwiając programistom korzystającym z narzędzi Microsoft wybór między modelami Llama Meta i OpenAI GPT podczas tworzenia doświadczeń AI.

Meta AI: Co to jest lama 2?

Zoptymalizowano architekturę transformatora autoregresyjnego modelu językowego Llama 2. Zamierzone jest komercyjne i akademickie wykorzystanie Lamy 2 w języku angielskim. Występuje w różnych wstępnie wytrenowanych i dostrojonych wariantach, a także w rozmiarach parametrów od 7 miliardów do 70 miliardów.

Według Meta, ulepszone wersje dostosowują się do ludzkich preferencji w zakresie bezpieczeństwa i przydatności poprzez nadzorowane dostrajanie (SFT) i uczenie się wzmacniające z ludzkimi opiniami (RLHF). Do wstępnego szkolenia Lamy 2 wykorzystano 2 biliony tokenów danych z publicznie dostępnych źródeł.

Podczas gdy wstępnie przeszkolone modele mogą być modyfikowane pod kątem szeregu zadań generujących język naturalny, modele dostosowane są zaprojektowane do konwersacji podobnej do asystenta. Bez względu na to, jaki model wybierze programista, wskazówki dotyczące odpowiedzialnego użytkowania Meta AI mogą pomóc w ukierunkowaniu wszelkich dalszych dopracowań, które mogą być wymagane w celu dostosowania i optymalizacji modeli z odpowiednimi ograniczeniami bezpieczeństwa.

Jak korzystać z lamy 2?

Mamy doskonałe wieści, jeśli chcesz sam zagrać w Llama 2 od Meta AI. Huggingface ma łatwo dostępną wersję demonstracyjną. Po prostu zastosuj się do tych prostych kroków:

- Odwiedź tę stronę.

- Po przybyciu na stronę przewiń w dół, aż zobaczysz sekcję oznaczoną „Demo”.

- Jest tam okno czatu. Wpisz w nim wiadomość teraz.

- Aby wysłać wiadomość, naciśnij Enter.

Poprzez SageMaker JumpStart w SageMaker Studio UI i SageMaker Python SDK, możesz uzyskać dostęp do podstawowych modeli. W tej sekcji omawiamy znajdowanie modeli w SageMaker Studio.

Zintegrowane środowisko programistyczne (IDE) o nazwie SageMaker Studio oferuje pojedynczy internetowy interfejs wizualny, za pośrednictwem którego można uzyskać dostęp do narzędzi stworzonych specjalnie do wykonywania wszystkich zadań programistycznych ML, od gromadzenia danych po tworzenie, testowanie i wdrażanie modeli ML. Odnosić się do Studio Amazon SageMaker aby uzyskać więcej informacji na temat instalacji i konfiguracji SageMaker Studio.

W SageMaker Studio kliknij Gotowe i zautomatyzowane rozwiązania, aby uzyskać dostęp do SageMaker JumpStart, który zawiera wstępnie wytrenowane modele, notebooki i gotowe rozwiązania.

Możesz wyszukiwać rozwiązania, modele, notatniki i inne zasoby na stronie docelowej SageMaker JumpStart. W karuzeli Foundation Models: Text Generation do wyboru są dwa wyróżniające się modele Lamy 2. Zaktualizuj swoją wersję SageMaker Studio, zatrzymując ją i wznawiając, jeśli nie widzisz modeli Lamy 2. Więcej informacji na temat aktualizacji wersji można znaleźć w części Zamykanie i aktualizowanie aplikacji Studio.

Wybierając Eksploruj wszystkie modele generowania tekstu lub wpisując „lamę” w polu wyszukiwania, możesz również zlokalizować pozostałe cztery warianty modelu.

Aby przeczytać informacje o modelu, w tym o jego licencjonowaniu, wykorzystanych danych treningowych i instrukcjach użytkowania, wybierz kartę modelu. Wdróż i Otwórz notatnik to dwa dodatkowe przyciski, które pomagają w korzystaniu z modelu.

Musisz rozpoznać umowę licencyjną użytkownika końcowego i akceptowalne zasady użytkowania w wyskakującym okienku po wybraniu dowolnego przycisku.

Po zatwierdzeniu przejdziesz do następnej fazy wykorzystania modelu.

Poniższy przykład pokazuje, jak zastosować modele lamy z kilkukrotnym uczeniem się w kontekście, dając modelowi dostęp do danych szkoleniowych. Należy pamiętać, że wyciągamy wnioski tylko z modelu, który został wdrożony, a wagi modeli pozostają stałe przez cały czas.

Wejście: Przetłumacz z angielskiego na francuski:

wydra morska => loutre de mer

mięta pieprzowa => menthe poivrée

pluszowa żyrafa => żyrafa peluche

ser =>Wyjście:

z wieku

czekolada => czekolada

samochód => podróż

chomik => chomik

piwo => piwo

rower => rowerek

banan => banan

truskawka => fraise

pizza => pizza

cheeseburger => cheeseburger

ananas => ananas

marchewka => marchewka

arbuz => pasta

wieloryb => balein

bakłażan => bakłażan

kot => czat

pingwin => manchot

lew => lew

słoń => słoń

panda => panda

tygrys => tygrys

łosoś => saumon

wiewiórka => écureuil

kangur => kangur

żółw => tort

ośmiornica => poulpe

żaba => grenouille

świnia => cochon

złota rybka => poisson rouge

rekin tygrysi => rekin tygrysi

goryl => goryl

dol

Meta-AI

Dostępność Lamy 2 w Sztuczna inteligencja platformy Azure biblioteka modeli została ujawniona przez Microsoftu na konferencji Microsoft Inspire. Teraz programiści mogą go używać do tworzenia. Ponadto jest przeznaczony do działania lokalnie w systemie Windows, aby uprościć przepływy pracy dla programistów AI. AWS Amazon SageMaker Centrum Jumpstart oferuje również Llama 2, a kolejni dostawcy pójdą w jego ślady.

Uruchomienie otwarty ekosystem Ujawniono również współpracę Microsoft i Meta AI w zakresie wymiennych platform AI. Standard Open Neural Network Exchange (ONNX) dla modeli głębokiego uczenia się został po raz pierwszy ogłoszony w 2017 roku przez Meta AI (wcześniej Facebook) i wtedy rozpoczął się rozwój.

Obaj zobowiązali się do wspierania rozwoju otwartej sztucznej inteligencji, w szczególności poprzez zapewnienie większej liczbie przedsiębiorstw na całym świecie dostępu do podstawowej technologii sztucznej inteligencji.

Według Meta AI modele Llama 2 zostały poddane procesowi red teamingu, w ramach którego pracownicy mieli za zadanie zidentyfikować słabości w architekturze bezpieczeństwa modeli i zapewnić ich bezpieczeństwo. Ponadto do stworzenia „podpowiedzi kontradyktoryjnych” wykorzystano źródła zewnętrzne, które miały pomóc w dopracowaniu modelu.

Schemat przezroczystości w pliku artykuł naukowy wyszczególnienie Lamy 2 przedstawia wady modelu, a także sposób, w jaki Meta planuje sobie z nimi poradzić w przyszłości. Użytkownicy Lamy 2 są zobowiązani do przestrzegania „akceptowalne użycie”, która zabrania używania modelu do tworzenia szkodliwego kodu, zezwalania na nieuprawnione przekazywanie informacji lub materiałów nieletnim lub tworzenia treści promujących terroryzm. Możesz uzyskać dostęp do pełna lista tutaj.

Aby zachęcić programistów do przyjęcia modelu języka „do rozwiązywania trudnych problemów”, Meta uruchomiła Wyzwanie Uderzenia Lamya więcej informacji wkrótce.

Zanim wyjdziesz, przeczytaj nasz artykuł: 15 najlepszych pomysłów na sztuczną inteligencję postaci, aby lepiej cieszyć się rozmowami

Kredyt na wyróżniony obraz: Nierozpryskiwany.

Source: Meta AI: Co to jest lama 2 i jak z niej korzystać? • TechKrótko