Sztuczna inteligencja (AI) od dawna fascynuje niektórych ludzi, a inni ją krytykują. Trudno jest przewidzieć, co jest możliwe, a co nie w przypadku AI. Grupa naukowców z University of British Columbia (UBC) w Vancouver wymyśliła coś, co może wydawać się science fiction: w pełni autonomicznego naukowca AI. Ta AI analizuje dane, a także tworzy i przeprowadza eksperymenty. To odkrycie ma zarówno fascynujące, jak i, dla niektórych, niepokojące implikacje.

Choć pomysł naukowca zajmującego się sztuczną inteligencją może wydawać się nierealnym marzeniem, Zespół UBC stała się rzeczywistością dzięki współpracy z Uniwersytetem Oksfordzkim i Sakana AI. Chociaż te dokumenty robocze generowane przez AI mogą początkowo nie wnosić wiele do nauki, fakt, że są wynikiem uczenia maszynowego na podstawie eksperymentów i że działają, stanowi postęp w badaniach nad AI.

Naukowiec zajmujący się sztuczną inteligencją, który nigdy nie przestaje się uczyć

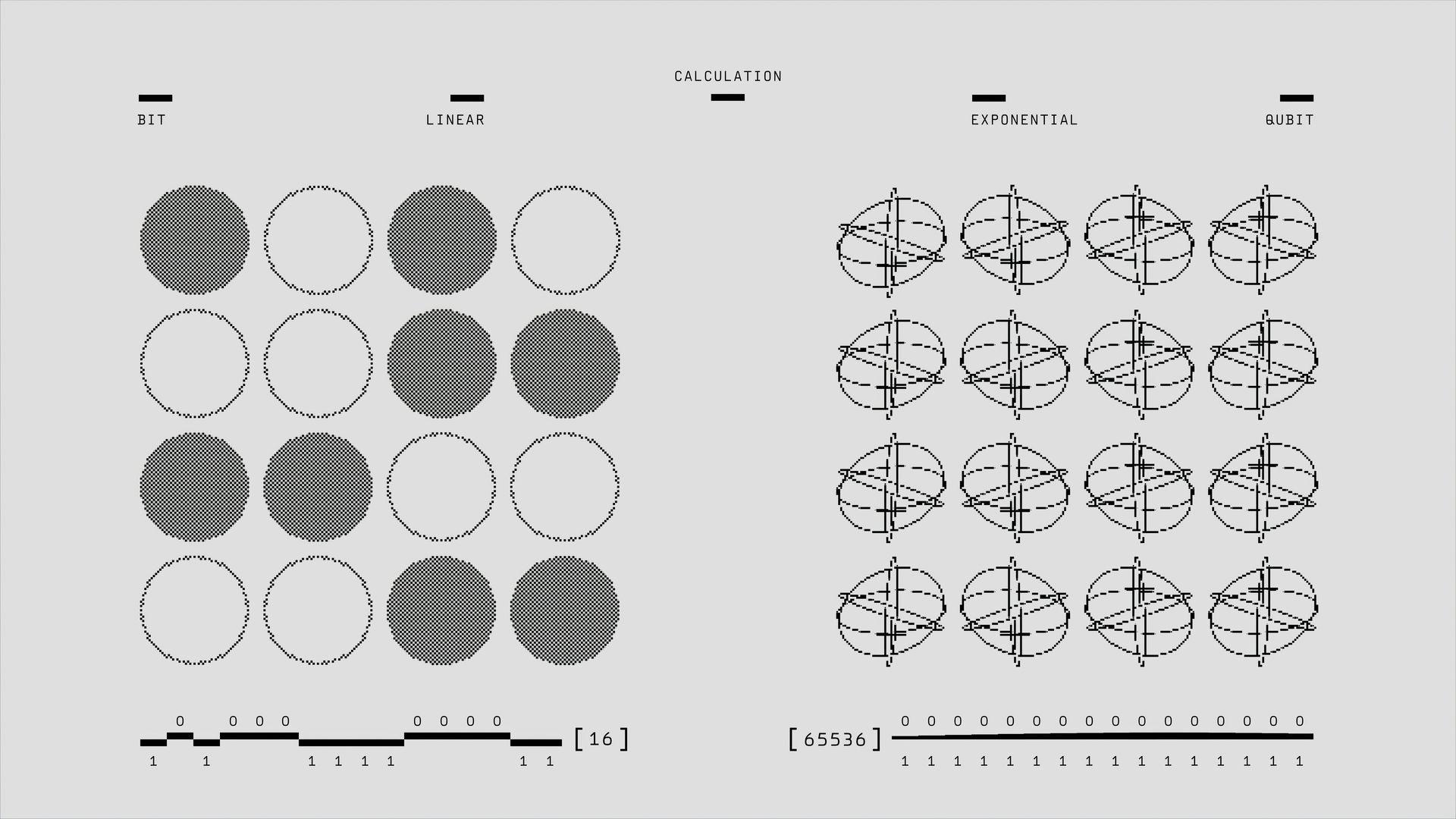

Ta praca koncentruje się wokół podejścia zwanego nauką otwartą. Ten nowy naukowiec AI działa inaczej niż tradycyjna sztuczna inteligencjaktóra jest zależna od ogromnych ilości danych tworzonych przez ludzi. Uczy się, próbując nowych rzeczy, badając je i udoskonalając. Korzystając z tej techniki, AI może poszerzyć granice obecnej wiedzy i być może znaleźć nowe spostrzeżenia, które ludzcy badacze mogli przegapić.

Jednym z pierwszych zadań, jakich podjął się ten naukowiec zajmujący się sztuczną inteligencją, było udoskonalenie istniejących technik uczenia maszynowego, takich jak modelowanie dyfuzji i przyspieszanie głębokie sieci neuronowe. Choć te osiągnięcia mogą nie wydawać się przełomowe, to jednak reprezentują zdolność AI do autonomicznego rozwijania i testowania pomysłów. Sama AI nie mogła robić wielu rzeczy, kiedy się pojawiła, ale teraz zaczęła wkraczać w każdy aspekt naszego życia.

Jeff Cluneprofesor kierujący laboratorium UBC, przyznał, że wyniki niekoniecznie są sukcesem, ale są obiecujące. Podejście naukowca AI do nauki — ciągłe udoskonalanie eksperymentów i poszukiwanie rzeczy, które uważa za „interesujące” — to świeże odejście od bardziej sztywnych metod tradycyjnie stosowanych w badaniach nad AI.

Naukowcy zajmujący się sztuczną inteligencją niezależnie kodują i udoskonalają swoje teorie

Laboratorium Clune’a eksperymentuje z nauką otwartą od jakiegoś czasu. W poprzednich projektach opracowali programy AI zaprojektowane do eksploracji środowisk wirtualnych i generowania zachowań na podstawie tego, co uważają za interesujące. Te programy musiały być ostrożnie prowadzone za pomocą ręcznie kodowanych instrukcji, ale wprowadzenie dużych modeli językowych (LLM) zmieniło zasady gry. Teraz te programy AI mogą niezależnie określać, co warto zbadać, co czyni je bardziej autonomicznymi i potencjalnie bardziej kreatywnymi.

Zdolność naukowca AI do pisania kodu potrzebnego do walidacji jego teorii, a także przeprowadzania testów, jest jednym z jego najbardziej fascynujących atrybutów. Pozwala to AI na ciągłe udoskonalanie swojej strategii, stając się coraz skuteczniejszym i być może bardziej spostrzegawczym. Clune porównuje ten proces do odkrywania nowego kontynentu, ponieważ oba wiążą się z duchem eksploracji i nieznanego oraz możliwością wielkich niespodzianek po drodze.

Niezawodność takich systemów jest słaba, pomimo ich świetlanej przyszłości. Podczas gdy naukowcy AI mogą wydawać się niezwykli, Tom Nadziejabadacz w Instytut Allena ds. AImówi, że nadal jest wysoce wtórna i zawodna. Ta nieufność wynika z faktu, że AI obiecuje za dużo i nie spełnia oczekiwań, szczególnie w obszarach kreatywności i prawdziwej innowacji.

Zarządzanie potencjałem i ryzykiem

Wraz z powstaniem naukowca AI pojawiły się również obawy dotyczące kierunku badań naukowych. Kiedy AI będzie w stanie samodzielnie tworzyć i oceniać teorie, gdzie będą ludzcy badacze? Ponadto, w jaki sposób możemy zapewnić, że te technologie AI będą wykorzystywane właściwie? Czy złośliwa osoba mogłaby szkolić naukowca AI w domu i wykorzystywać go do złe cele w przyszłości?

Ten naukowiec zajmujący się sztuczną inteligencją już czyni postępy w tworzeniu agentów AI, czyli autonomicznych programów z ustalonymi funkcjami. Grupa Clune’a stworzyła agentów zaprojektowanych przez AI, którzy przewyższają ich zaprojektowany przez człowieka odpowiedniki w takich umiejętnościach jak matematyka i czytanie ze zrozumieniem. Ten sukces sugeruje przyszłość, w której AI mogłaby przyczyniać się do innowacji w sposób, który jest nadal niejasny, a nie tylko pomagać w codziennych czynnościach.

Ale z tym postępem wiążą się zagrożenia. Jest dość niepokojące, że te systemy AI mogą produkować źle zachowujących się agentów, celowo lub nie. Clune i jego grupa są świadomi ryzyka i próbują znaleźć rozwiązania, aby zapobiec tego typu sytuacjom. Twierdzą, że sekretem jest odpowiednie nadzorowanie tworzenia tych systemów, aby zagwarantować ich siłę i bezpieczeństwo.

Chociaż nie wiadomo, dokąd to doprowadzi, jedno jest pewne: naukowcy zajmujący się sztuczną inteligencją są tutaj i nie przestaną stawać się mądrzejsi. Sztuczna inteligencja wchodzi w nową fazę i wszyscy będą uważnie obserwować, czy doprowadzi to do przełomowych odkryć lub nowych problemów. W miarę rozwoju sztucznej inteligencji kluczowe będzie, aby naukowcy podkreślali kwestie etyczne i dbali o to, aby te systemy były budowane w sposób etyczny. Ostatecznie sposób, w jaki zajmiemy się złożoną relacją między technologią a ludźmi, zadecyduje o tym, jak sztuczna inteligencja wpłynie na społeczeństwo.

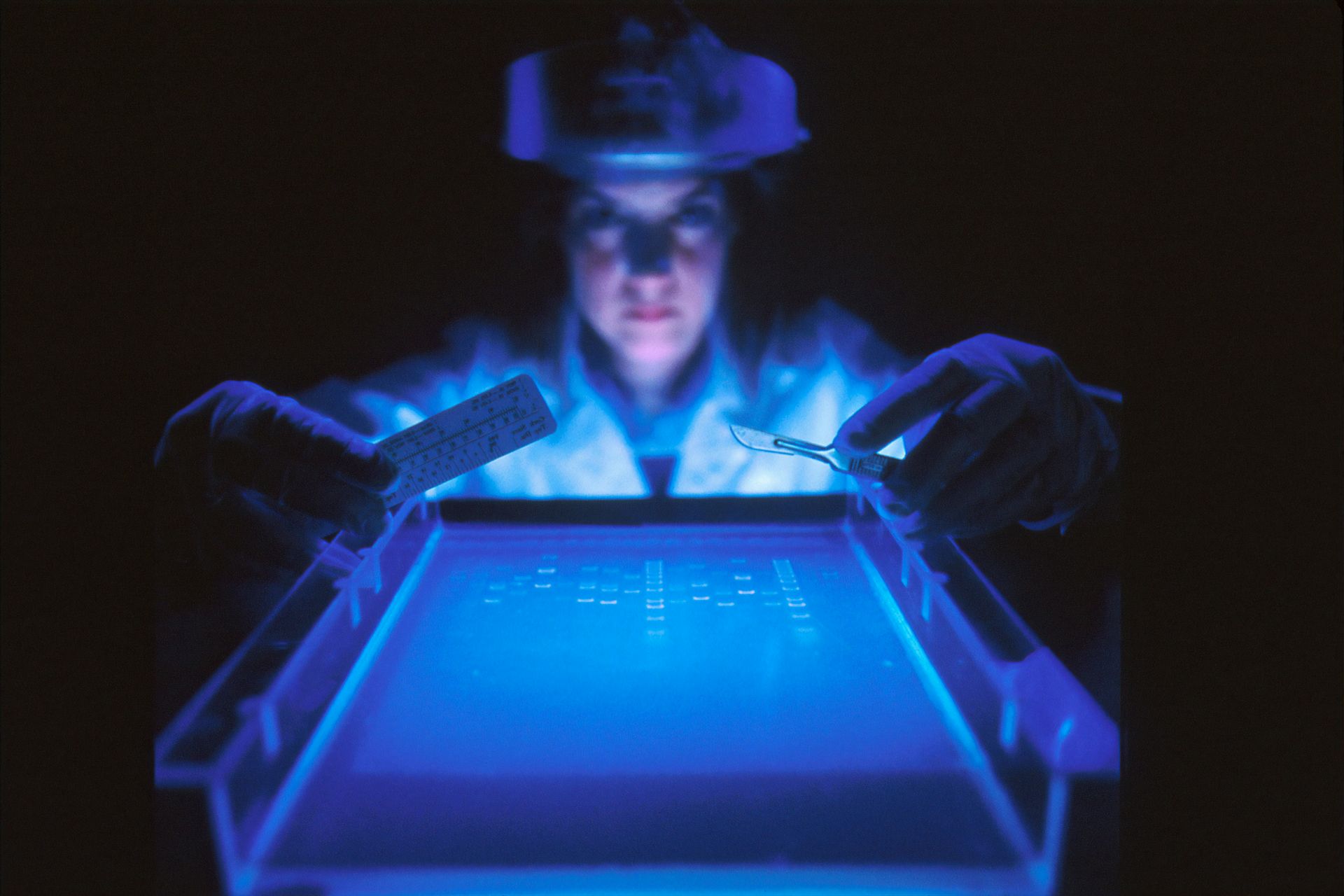

Źródło wyróżnionego obrazu: Narodowy Instytut Raka / Unsplash

Source: Naukowcy zajmujący się badaniami nad sztuczną inteligencją uczą się i odkrywają