Apple zdecydowało się pójść dalej w walce z pornografią dziecięcą. Firma stworzyła nowy system skanowania i szyfrowania, za pomocą którego będzie śledzić zdjęcia swoich użytkowników w poszukiwaniu podejrzanych treści. Nowa funkcja oparta na uczeniu maszynowym na razie nie pojawi się w niektórych krajach, najpierw zostanie przetestowana w Stanach Zjednoczonych, ale już wzbudziła podejrzenia wśród ekspertów ds. cyberbezpieczeństwa.

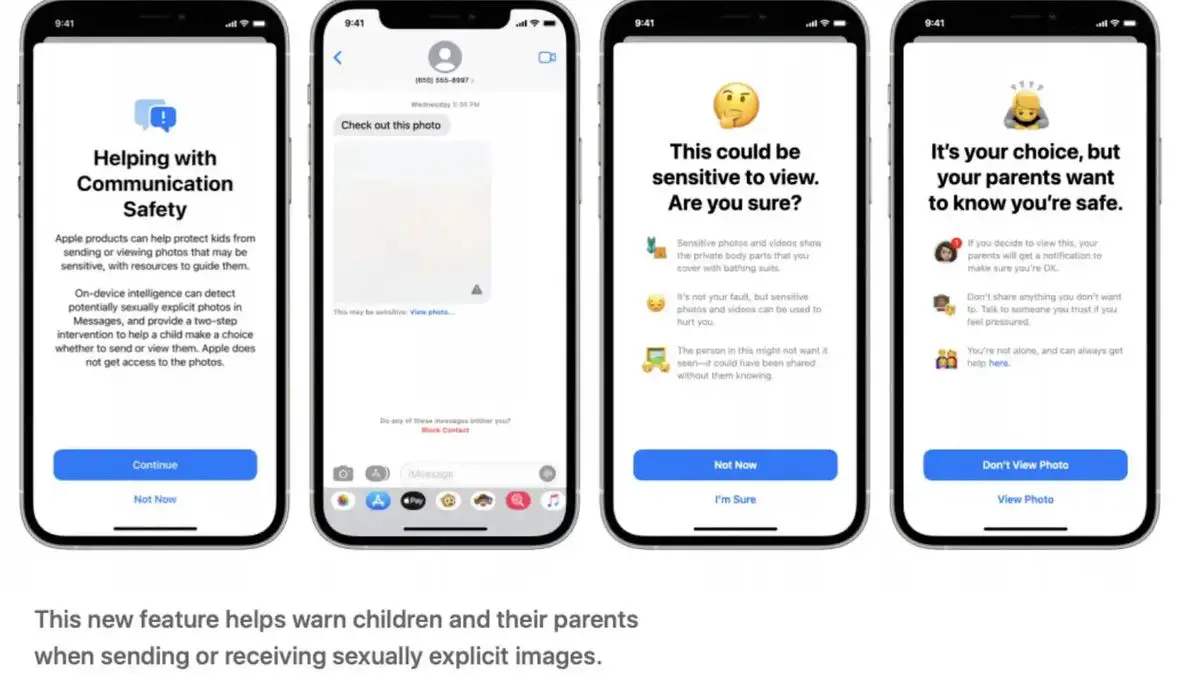

Firma potwierdziła w ten sposób informacje podane na Twitterze przez Matthew Greena, profesora kryptografii na Uniwersytecie Johnsa Hopkinsa, w czwartek. Od tej chwili użytkownicy iPhone’a będą otrzymywać alert, jeśli którykolwiek z obrazów, które próbują wysłać przez iMessage, będzie podejrzewany o wykorzystywanie seksualne nieletnich.

„Wiadomości wykorzystują uczenie maszynowe na urządzeniu do analizowania załączników graficznych i określania, czy zdjęcie ma charakter erotyczny. Ta funkcja została zaprojektowana tak, aby Apple nie miał dostępu do Wiadomości” szczegóły Apple w raporcie opisującym działanie tego systemu, który nie jest tak nowy, jak się wydaje.

Jak to działa?

Technologia zostanie wykorzystana w iOS, macOS, WatchOS i iMessages, skąd zostaną przeanalizowane wszystkie obrazy, które użytkownicy zamierzają udostępnić. W tym celu wykorzystali algorytmy uczenia maszynowego znane jako NeuralHash.

Technologia hash analizuje obraz bez konieczności przeglądania go lub otwierania pliku. Konwertuje każde zdjęcie na unikalny numer opisujący jego zawartość, jak cyfrowy odcisk palca, którego żaden użytkownik nie byłby w stanie zrozumieć.

Po porównaniu tego kodu z kodami ustalonymi przez firmę jako podejrzane treści, jeśli zostanie wykryta wystarczająca liczba dopasowań między jednym kodem a drugim, tworzony jest alert, który zamazuje obraz i blokuje jego udostępnianie.

Apple zapewnia, że rodzice będą mogli otrzymywać alerty, jeśli ich dzieci będą chciały wysłać treści sklasyfikowane jako podejrzane. Władze mogą również zostać powiadomione o tych meczach, aby zespół ludzki mógł przejrzeć obrazy.

Mateusz Green wyjaśnia na swoim koncie na Twitterze, że ta technologia może dawać fałszywe alarmy, ponieważ nie są one zbyt dokładne: „To jest celowe. Zostały zaprojektowane tak, aby znajdować obrazy, które wyglądają jak złe obrazy, nawet jeśli zostały zmienione, skompresowane itp.” Firma zaprzecza temu twierdzeniu: „Ryzyko nieprawidłowego oflagowania konta przez system jest bardzo niskie. Ponadto Apple ręcznie przegląda wszystkie raporty przesłane do NCMEC, aby zapewnić dokładność raportów”.

Zagrożenia prywatności

To, co mogłoby być kluczowym narzędziem ścigania przestępców, pedofilów i terrorystów, stanowi jednocześnie zagrożenie dla prywatności niewinnych obywateli i bardzo przydatną broń dla totalitarnych reżimów – denuncjuje ekspert ds. cyberbezpieczeństwa.

Problem z tym nowym narzędziem wolałby raczej polegać na tym, gdzie będą szukać tych podobieństw. Zdjęcia przechowywane na urządzeniach i przechowywane w iCloud są przechowywane w postaci zaszyfrowanej na serwerach Apple, ale jak wyjaśniają eksperci, klucze do odszyfrowania tych kodów są własnością Apple.

Jedyne, które mają szyfrowanie end-to-end (E2E), to te z iMessages, które, podobnie jak WhatsApp, są chronione z jednego urządzenia na drugie, aby nikt oprócz użytkowników nie mógł ich zobaczyć. W tym miejscu teoretycznie miałby się pojawić nowy system Apple’a.

Ta analiza treści nie jest taka nowa. Facebook skanuje posty pod kątem nagości w swoich sieciach społecznościowych (Facebook i Instagram). Apple używa również systemów mieszających do wyszukiwania obrazów przedstawiających wykorzystywanie dzieci wysyłanych pocztą e-mail, systemów podobnych do Gmaila i innych dostawców poczty e-mail w chmurze, które nie są chronione przez szyfrowanie typu end-to-end.

Green uważa, że ta technologia wysyła niepokojący komunikat. „Niezależnie od długofalowych planów Apple’a wysłali bardzo wyraźny sygnał. (…) bezpiecznie jest budować systemy skanujące telefony użytkowników w poszukiwaniu zabronionych treści – wyjaśnia na swoim profilu na Twitterze.

Jednak nie wszyscy eksperci ds. cyberbezpieczeństwa byli tak krytyczni. Nicholas Weaver, starszy pracownik naukowy w Międzynarodowym Instytucie Informatyki na Uniwersytecie Kalifornijskim w Berkeley, zapewnił Płyta główna że nowa funkcja Wiadomości firmy Apple „wydaje się BARDZO dobrym pomysłem”. „Ogólnie rzecz biorąc, podejście Apple wydaje się dobrze przemyślane, aby być skuteczne i maksymalizować prywatność” – dodaje.