Opierając się na Szeptnaukowcy z Oksfordu opracowują WhisperX do skutecznego znakowania czasem na poziomie słów długie transkrypcje mowy.

Ze względu na dostępność obszernych zbiorów danych online, słabo nadzorowane i nienadzorowane metody szkoleniowe wykazały wyjątkową wydajność w różnych zadaniach przetwarzania dźwięku, w tym głosuznanie, głośnikuznanie, przemówienieseparacjaI słowo kluczoweplamienie.

Jak działają Whisper i WhisperX?

Whisper, system rozpoznawania mowy stworzony przez badacze z Oksfordu, wykorzystuje te istotne informacje na większą skalę. Pokazują, jak słabo nadzorowane wstępne szkolenie podstawowego transformatora koder-dekoder może osiągnąć zero-shot wielojęzycznej transkrypcji mowy na uznanych testach porównawczych przy użyciu 125 000 godzin danych tłumaczeń na język angielski I 680 000 godzin hałaśliwych danych dotyczących treningu mowy w 96 dodatkowych językach.

Podczas gdy większość akademickich testów porównawczych składa się z krótkich stwierdzeń, w rzeczywistych kontekstach, takich jak spotkania, podcasty i filmy, często potrzebna jest transkrypcja długich nagrań, które mogą trwać godzinami lub minutami.

Projekty transformatorów stosowane w automatyczne rozpoznawanie mowy Modele (ASR) nie pozwalają na transkrypcję dowolnie długiego dźwięku wejściowego (do 30 sekund w przypadku szeptu) ze względu na ograniczenia pamięci.

Ostatnie badania wykorzystują heurystyczne metody przesuwania okien, które są podatne na błędy ze względu na niekompletny dźwięk, gdzie niektóre słowa mogą zostać pominięte lub nieprawidłowo przepisane, jeśli znajdują się na początku lub na końcu segmentu wejściowego; I nakładające się dźwiękico może skutkować niespójnymi transkrypcjami, gdy model dwukrotnie przetwarza tę samą mowę.

Whisper przedstawia technikę transkrypcji buforowanej, która określa jak daleko należy przesunąć okno wprowadzania oparte na dokładne przewidywanie znacznika czasu. Taka metoda jest podatna na poważne dryfowanie, ponieważ niedokładności znacznika czasu w jednym oknie mogą powodować problemy w kolejnych oknach.

Używają wielu domowych heurystyk, aby spróbować wyeliminować te błędy, chociaż często im się to nie udaje. Połączone dekodowanie Whisper, które wykorzystuje pojedynczy koder-dekoder do dekodowania znaczników czasu i transkrypcji, jest podatny na typowe problemy z autoregresywnym generowaniem językazwłaszcza halucynacje i powtórzenia.

Długie formularze i inne działania wrażliwe na znaczniki czasu, takie jak diaryzacja mówcy, czytanie z ustI nauka audiowizualna mają na to niekorzystny wpływ, jak również na buforowaną transkrypcję.

Papier Szeptu twierdzi, że znaczna część korpusu szkoleniowego składa się z niekompletne dane (pary transkrypcji audio bez informacji o znacznikach czasu), oznaczone tokenem |nottimestamps|>. Nieumyślnie poświęca się wydajność transkrypcji mowy mniej dokładny znacznik czasu przewidywanie podczas skalowania na niedoskonałym i zaszumionym materiale transkrypcyjnym.

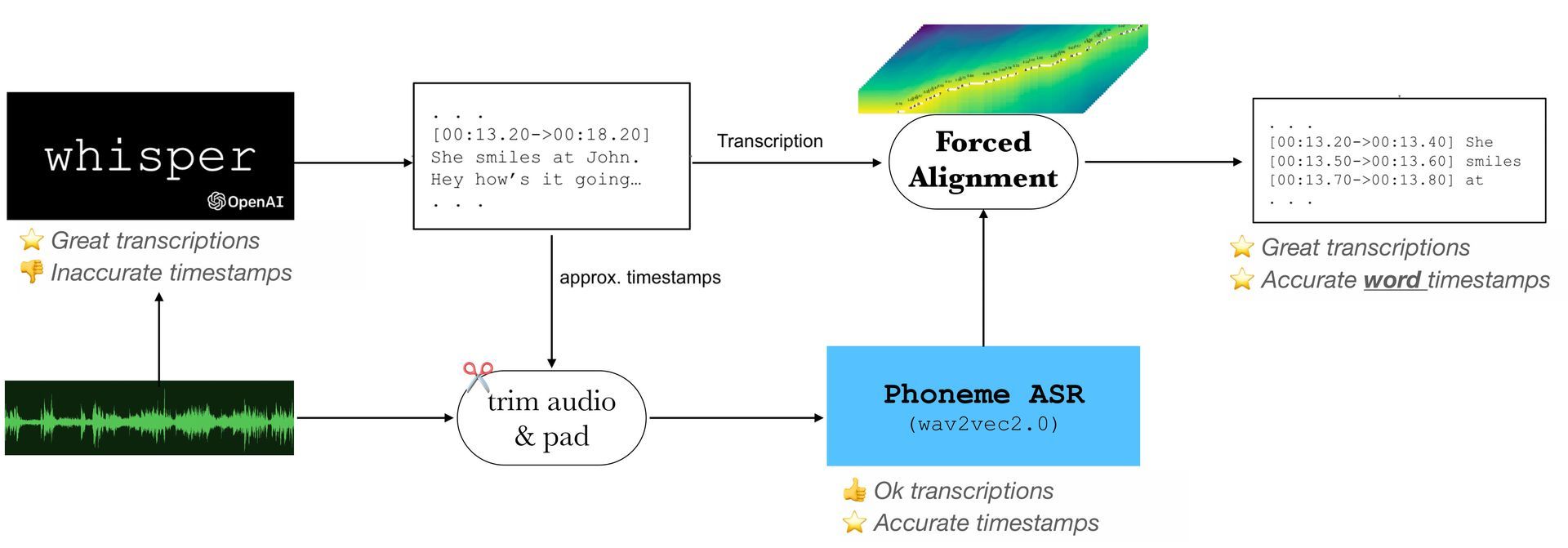

W rezultacie podczas korzystania z dodatkowych modułów mowa i transkrypcja muszą być odpowiednio dopasowane. W “wymuszone wyrównanie„transkrypcja mowy i fale dźwiękowe są synchronizowane na poziomie słowa lub fonemu. The Ukryty model Markowa (HMM) i produkt uboczny możliwych wyrównań stanów są często wykorzystywane w szkoleniu modeli telefonów akustycznych.

Modele korekcji granic zewnętrznych są często używane do poprawiania znaczników czasu dla tych słów lub numerów telefonów. W związku z szybką ekspansją metodologii opartych na głębokim uczeniu sięniektóre niedawne badania wykorzystują techniki głębokiego uczenia się do wymuszonego wyrównania, takie jak zastosowanie dwukierunkowej macierzy uwagi lub segmentacja CTC z modelem wyszkolonym od końca do końca.

Dalszą poprawę można osiągnąć, łącząc najnowocześniejszy model ASR z prostym modelem rozpoznawania fonemów, z których oba zostały zbudowane przy użyciu znacznych zbiorów danych na dużą skalę.

Kiedy WhisperX pojawia się na obrazie

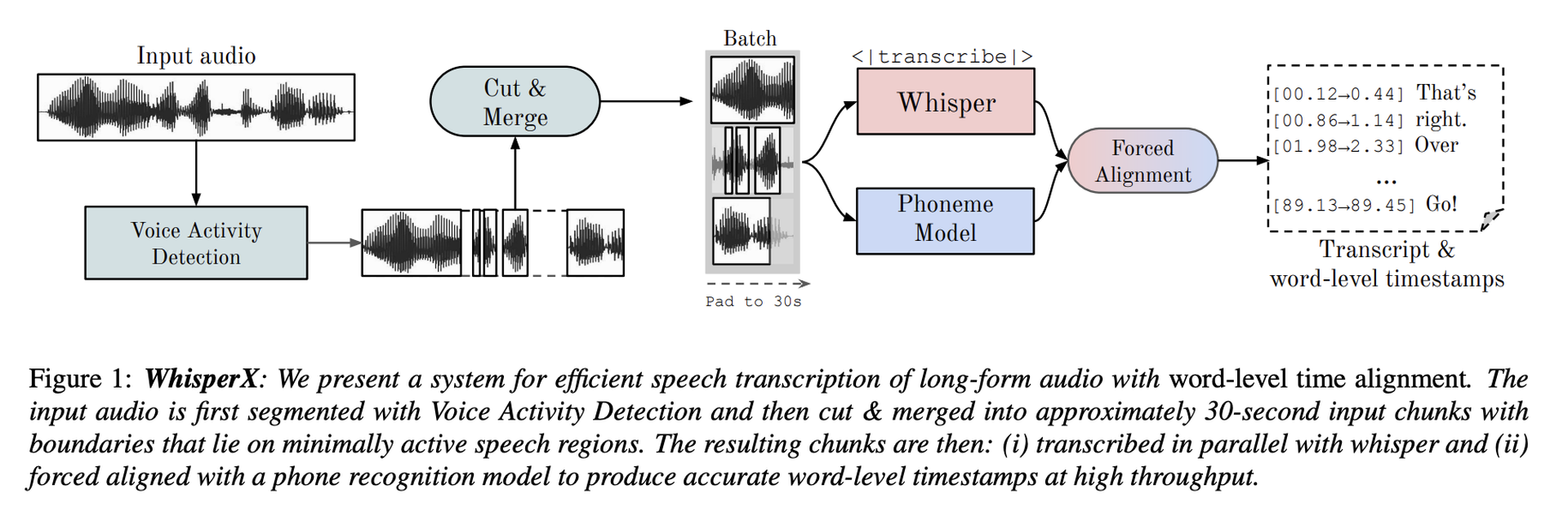

proponują WhisperX, technika dokładnej transkrypcji mowy długich nagrań z precyzyjnymi znacznikami czasu na poziomie słów, jako rozwiązanie tych problemów. oprócz transkrypcja szeptanaobejmuje również następujące trzy etapy:

- Wykorzystanie zewnętrznego modelu wykrywania aktywności głosowej (VAD) do wstępnej segmentacji przychodzącego dźwięku.

- Powstałe segmenty VAD są dzielone i łączone w mniej więcej 30-sekundowe fragmenty wejściowe z ograniczeniami na regionach mowy o najmniejszej aktywności.

- Aby dostarczyć dokładne znaczniki czasu na poziomie słów, wymagają dostosowania do zewnętrznego modelu fonemów.

Wraz z rozwojem sztucznej inteligencji i tekstowych chatbotów AI, programy do zamiany tekstu na mowę i rozpoznawania mowy cieszą się dużym zainteresowaniem. Tylko w tym tygodniu została wydana aplikacja czatu wideo ChatGPT Call Annie AI, aby wykorzystać ten rosnący popyt. Chociaż przyszłość WhisperX nie jest jeszcze do końca jasna, jeśli chodzi o jego możliwości, można powiedzieć, że zdecydowanie warto śledzić jego postępy.