Czy sztuczna inteligencja może sobie wyobrazić rzeczy? Wyobraźnia to złożony proces. Jeśli przestaniemy myśleć o liczbie elementów, które mogą składać się na wyimaginowany scenariusz, łatwiej będzie zacząć zbliżać się do pojęcia, jak głęboka może być ta mentalna procedura.

Zespół naukowców z Uniwersytetu Południowej Kalifornii w USA przedstawił projekt, którego celem jest nadanie sztucznej inteligencji podobnej jakości w celu wdrożenia systemów zdolnych do tworzenia nowych koncepcji w oparciu o znane elementy.

Nowy system, który pozwala wyobrazić sobie sztuczną inteligencję

Na pierwszy rzut oka pomysł trenowania systemu sztucznej inteligencji z „ludzkimi możliwościami” może brzmieć dziwnie. Ma to jednak praktyczny, interesujący i przystępny cel.

Proces wyobraźni jest ogólnie definiowany jako proces twórczy, w którym na podstawie wcześniej dostrzeżonych elementów konstruowane są nowe obrazy mentalne. Przenosząc to na płaszczyznę AI, system, który opanowuje dużą liczbę formuł leków, może na przykład rozłożyć ich składniki i funkcje, aby rozpocząć testowanie nowych receptur.

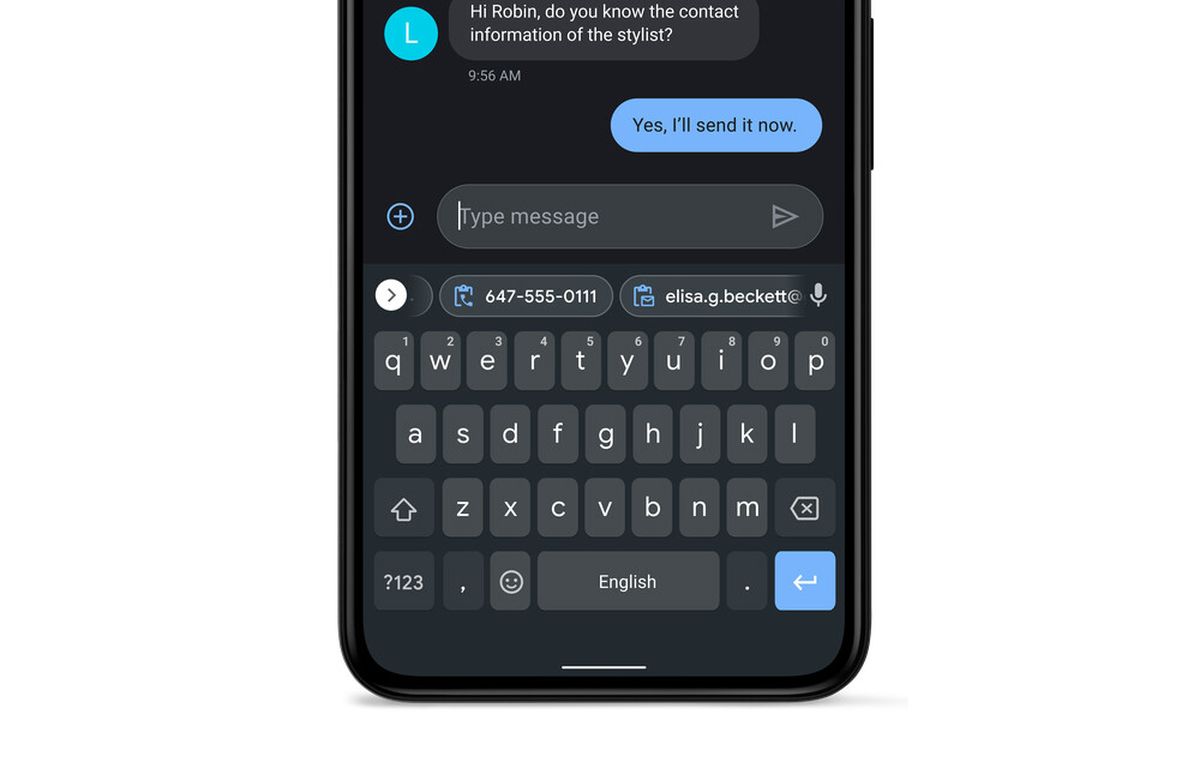

Tego rodzaju mechanizmy były już wcześniej prezentowane, ale ograniczone w swoim działaniu do pewnego kontekstu, jak chociażby wspomniany przykład leków. W przeciwieństwie do nich sztuczna inteligencja opracowana przez naukowców z USC może być ekstrapolowana na różne zastosowania. Oznacza to, że w różnych scenariuszach system ten powinien mieć możliwość definiowania własnych reguł i zmiennych, aby skonfigurować jak najwięcej kombinacji atrybutów.

Aby osiągnąć tę wszechstronność, badacze zastosowali mechanizm podobny do tego, który stosuje się w generowaniu głębokich podróbek. Podobnie jak w przypadku tych oszukanych utworów audiowizualnych, algorytm może zidentyfikować twarz i gesty osoby, aby naśladować je z cyfrowo zastąpioną twarzą; w przypadku tej sztucznej inteligencji system byłby w stanie rozpoznać składniki każdego analizowanego scenariusza.

W rozmowa ze swoim domem studiów, student Yunhao Ge, członek zespołu odpowiedzialnego za ten rozwój, był przykładem tego procesu w oparciu o film Transformers. „Może przybrać kształt samochodu Megatron, kolor i pozę żółtego samochodu Bumblebee oraz tło nowojorskiego Times Square. Rezultatem będzie kolorowy samochód Bumblebee Megatron, jadący na Times Square, nawet jeśli tej próbki nie widziano podczas sesji treningowej” – skomentował.

W tym samym przypadku inny członek tego zespołu, profesor Laurent Itti, skomentował, że „głębokie uczenie się wykazało już niezrównaną wydajność i obietnicę w wielu dziedzinach, ale zbyt często dzieje się to poprzez powierzchowną mimikę i bez głębszego zrozumienia poszczególnych atrybutów, które uczynić każdy przedmiot wyjątkowym”, dodając, że „to nowe podejście do wyplątywania po raz pierwszy naprawdę wyzwala nowe poczucie wyobraźni w systemach AI, zbliżając je do ludzkiego rozumienia świata”.

Dzięki takim systemom samochody autonomiczne byłyby w stanie wyobrazić sobie jak najwięcej scenariuszy w oparciu o czynniki pogodowe i środowiskowe, zwiększając ich bezpieczeństwo. I tak, w miarę identyfikacji potrzeb zgodnych z ofertą tego systemu, katalog możliwych zastosowań może nadal rosnąć.

Szczegóły tych badań zostały upublicznione w artykule zatytułowanym „Synteza Zero Shot z uczeniem nadzorowanym przez grupę”, wydanym na tegorocznej Międzynarodowej Konferencji na temat reprezentacji uczenia się.