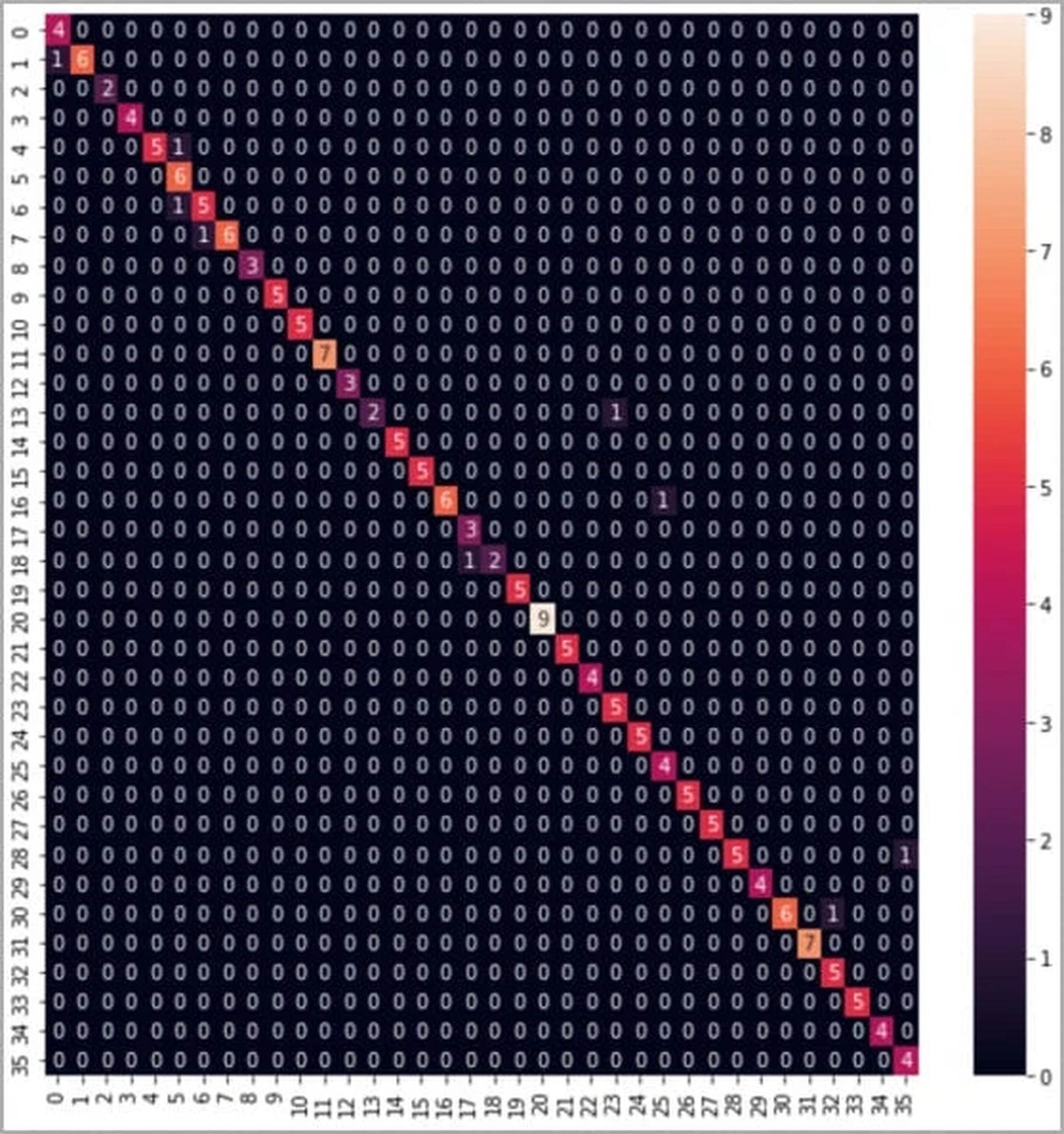

Postępy technologiczne wciąż zmieniają krajobraz cyberbezpieczeństwa, wprowadzając zarówno nowe możliwości, jak i nieprzewidziane zagrożenia. Zespół naukowców wywodzących się z brytyjskich uniwersytetów zademonstrował alarmujący exploit wykorzystuje fale dźwiękowe do kradzieży poufnych danych z naciśnięć klawiszy klawiatury. Technika, która wykorzystuje model głębokiego uczenia się, może się pochwalić imponujący wskaźnik dokładności na poziomie 95%.

Eksperyment opierał się na odkryciu, że można wykorzystać fale dźwiękowe generowane przez naciskanie klawiatury rozpoznać rzeczywiste naciśnięcia klawiszy. Badacze wyruszyli w pionierską podróż, której celem było zaprezentowanie potencjalne zagrożenia wynikające z ataków akustycznych na bezpieczeństwo danych.

Metodologia badań

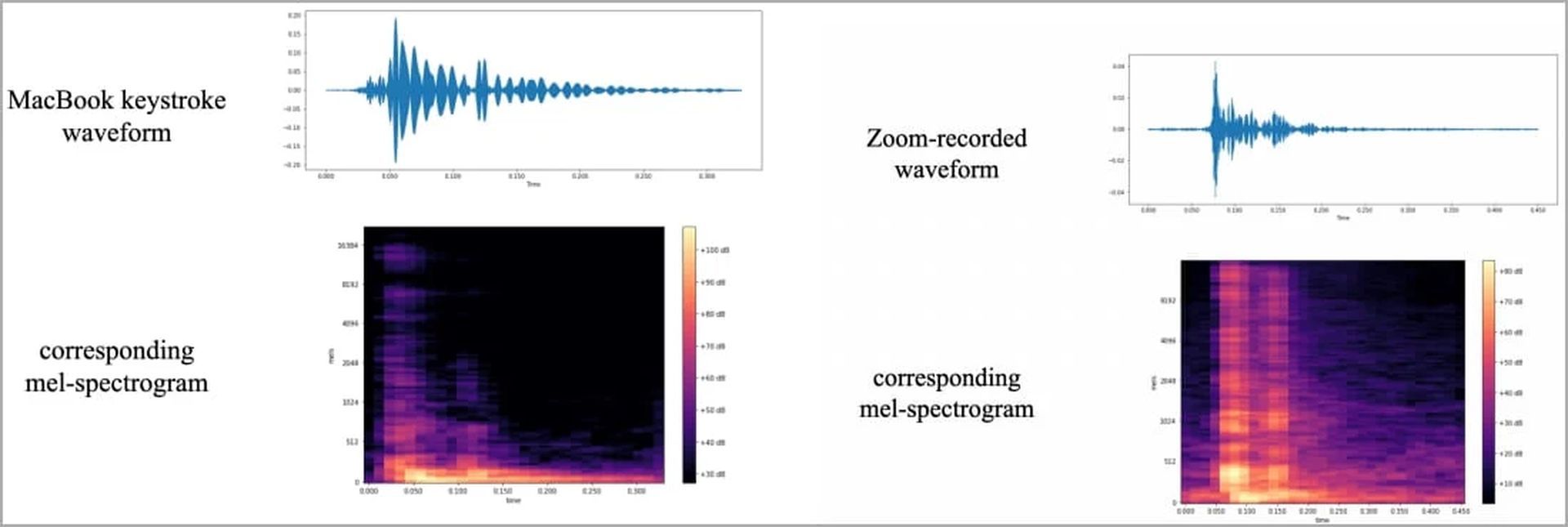

U podstaw tego zuchwałego wyczynu leży zawiłość wzajemne oddziaływanie dźwięku, uczenia maszynowego i ekstrakcji danych. Zespół badawczy wykorzystał szereg urządzeń, m.in laptopy Do smartfony, aby uchwycić unikalne profile dźwiękowe naciśnięć klawiszy. W sumie 36 klawiszy zostało naciśniętych po 25 razy na nowoczesnym MacBooku Pro, podczas gdy powstałe sygnały dźwiękowe zostały skrupulatnie zarejestrowane.

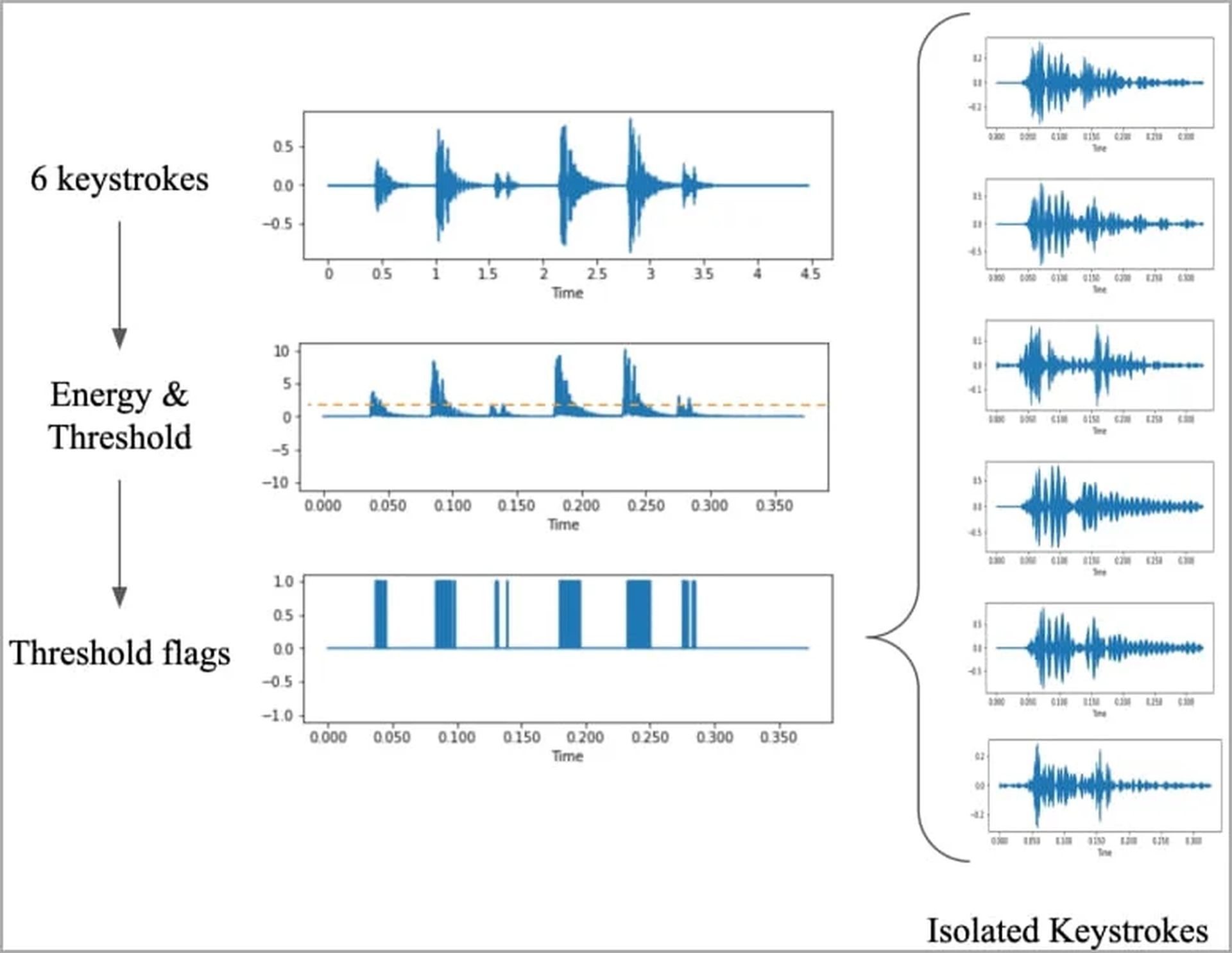

Przechwycone dane dźwiękowe zostały poddane szereg etapów obróbki, ostatecznie przekształcając się w reprezentacje wizualne, takie jak przebiegi i spektrogramy. Wizualizacje te przedstawiały charakterystyczne odmiany każdego naciśnięcia klawisza, torując drogę do opracowania potężnego klasyfikatora obrazów, nazwanego ‘CoAtNet‘

Implikacje wyników

Implikacje tych badań są głęboki I niepokojące. Ataki akustyczne omijać tradycyjne środki bezpieczeństwa, eksploatowanie wszechobecność urządzeń wyposażonych w mikrofon w celu uzyskania nieautoryzowanego dostępu do poufnych informacji. To nowatorskie podejście jest szczególnie niepokojące, ponieważ może potencjalnie ujawnić dane osobowe, w tym hasła, rozmowy, wiadomości, I inne poufne dane złośliwym podmiotom.

Tradycyjne ataki kanałami bocznymi zwykle wymagają określonych warunków i często są ograniczone ograniczenia szybkości transmisji danych i odległości. Jednak ataki akustyczne zapoczątkowały nową erę prostota I efektywność, wykorzystując obfitość urządzeń zdolnych do nagrywania wysokiej jakości dźwięk.

Strategie łagodzenia

Ponieważ te przełomowe badania podkreślają krytyczne znaczenie ochrony przed atakami akustycznymi, konieczne staje się zbadanie strategii ograniczania ryzyka, które użytkownicy mogą zastosować w celu ochrony swoich danych.

- Zmienione style pisania: Badanie zaleca użytkownikom rozważenie zmiany stylu pisania, aby zaciemnić sygnaturę akustyczną ich naciśnięć klawiszy.

- Losowe hasła: Używanie losowych haseł może zakłócić możliwości rozpoznawania wzorców przez atakujących akustycznie.

- Ochrona oparta na oprogramowaniu: Stosowanie oprogramowania, które naśladuje dźwięki naciskanych klawiszy, generuje biały szum lub wykorzystuje oparte na oprogramowaniu filtry audio, może potencjalnie udaremnić kradzież danych.

- Uwierzytelnianie biometryczne: Wdrożenie metod uwierzytelniania biometrycznego może zwiększyć bezpieczeństwo poprzez dodanie dodatkowej warstwy weryfikacji tożsamości.

- Menedżerowie haseł: Poleganie na menedżerach haseł może zminimalizować potrzebę ręcznego wprowadzania poufnych informacji, zmniejszając narażenie na ataki akustyczne.

W świecie charakteryzującym się szybki rozwój technologii, obawy związane z bezpieczeństwem również ewoluują. Badania służą jako wyraźne przypomnienie tego stale pojawiają się innowacyjne metody kradzieży danych, wymaga proaktywnego i adaptacyjnego podejścia do cyberbezpieczeństwa. Wraz z postępem świata cyfrowego, tak samo musi wyglądać nasza obrona przed tymi, którzy chcą wykorzystać jego słabości.

Oprócz badań prowadzonych na brytyjskich uniwersytetach, coraz częściej rozwijane są modele sztucznej inteligencji, które koncentrują się na kradzieży danych i praktykach hakerskich. W zeszłym miesiącu pojawił się model sztucznej inteligencji skupiający się na kradzieży danych o nazwie FraudGPT, a także model sztucznej inteligencji o nazwie WormgGPT, który twierdzi, że nie ma żadnych granic, umożliwiając nielegalne i nieetyczne rozmowy.

Jeśli chcesz być lepiej przygotowany na bieżące zmiany w głębokim uczeniu się i modelach sztucznej inteligencji, zapoznaj się z naszym artykułem o tym, jak wystrzegać się szeroko rozpowszechnionych oszustw ChatGPT.

Kredyt na wyróżniony obraz: Sergi Kabrera / Unsplash

Source: Naukowcy opracowują model głębokiego uczenia, który kradnie dane z naciśnięć klawiszy